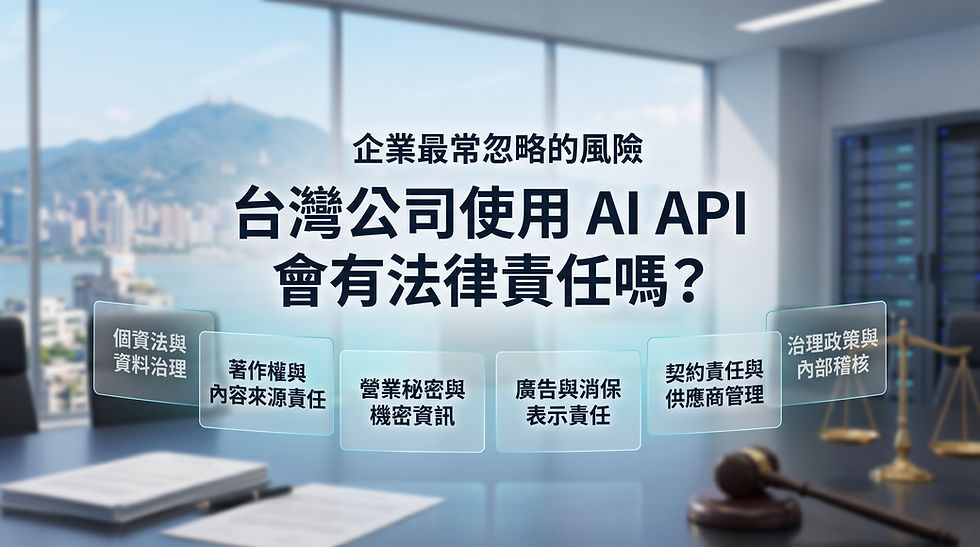

台灣公司使用 AI API 會有法律責任嗎?企業最常忽略的風險整理

- 4天前

- 讀畢需時 9 分鐘

台灣公司使用 AI API,答案不是「完全沒責任」,也不是「用了就一定違法」,而是一旦 AI 被接進企業流程,法律責任通常不會消失,只會從人工作業改成資料、流程、輸出與決策責任的重新分配。

尤其在台灣現行法制下,企業真正要先看的,往往不是「AI 能不能用」,而是用了之後會同時碰到哪些法律邊界:個資、營業秘密、著作權、廣告與消保、契約責任、內控制度,以及 2026 年已公布的《人工智慧基本法》所帶出的治理方向。

從主流供應商的官方文件來看,OpenAI 明確表示 API 平台與企業產品的資料預設不會拿來訓練模型;Anthropic 也表示商業產品資料不會用於訓練生成式模型;Google 則區分方案,Gemini Developer API 免費層資料可用於改善產品,但付費層不會,而 Vertex AI 也寫明未經許可或指示,不會用客戶資料訓練或微調模型。這些條款能降低部分風險,但不能直接把法律責任整包轉給供應商,因為企業自己怎麼蒐集、處理、輸入、授權、審核與使用輸出,仍然是責任核心。

為什麼台灣公司用了 AI API,法律責任不會自動消失

企業導入 AI API,最容易犯的第一個錯誤,就是把它當成「外部工具」而不是「企業流程的一部分」。但從法律角度來看,只要 AI 參與了企業的資料處理、內容產出、客服應對、內部判斷或對外訊息,責任就不會因為多了一層 API 而中斷。

AI 是工具,不是責任切斷器

如果公司用 AI API 寫客服回覆、產生廣告文案、分析客戶資料、摘要合約、生成投標內容,最後對外發生錯誤、侵權、誤導、洩密或違反個資規則,外界通常先看的是公司做了什麼、允許了什麼、控管了什麼,而不是先看模型是哪一家。

這不是因為供應商完全沒責任,而是企業作為資料控制、內容發布與決策執行的一方,本來就仍負主要責任。這屬於企業法遵與內控的一般原理,也與台灣《人工智慧基本法》強調的隱私與資料治理、透明、資安與責任原則一致。

台灣的 AI 治理方向已經很明確

台灣《人工智慧基本法》已於 2026 年 1 月 14 日公布,主管機關為國科會,並把隱私保護與資料治理、資通安全與安全性、透明與可解釋性、公平與不歧視、課責等列為核心原則。這部法不是直接告訴企業「用了 AI API 就罰什麼」,但它很明顯地釋出一個方向:AI 在台灣不是法外地帶,企業未來只會更需要把風險分級、資料治理與內部責任劃清楚。

最常見的第一層法律風險:個人資料

台灣公司只要把員工、客戶、會員、病患、學生、應徵者或合作對象的可識別資訊送進 AI API,就很容易先碰到《個人資料保護法》。

個資法管的不是只有外洩,還包括蒐集、處理、利用

台灣《個人資料保護法》本身就規範個人資料的蒐集、處理與利用,個資定義涵蓋姓名、出生年月日、證號、聯絡方式、財務狀況、社會活動、醫療、基因、健康檢查與其他可直接或間接識別自然人的資訊。也就是說,問題不只是「會不會外洩」,而是公司有沒有正當依據把這些資料送進模型流程。

2025 年修法後,通報與稽核風險更高

法務部對國際人權公約審查的官方說明提到,個資法於 2025 年 11 月修正公布後,政府機關在個資外洩等事件上被明文要求通知當事人、符合條件時向主管機關通報,且主管機關得進一步啟動稽核與檢查。雖然該段主要說明公部門,但也清楚反映台灣對個資事件的監理方向正在強化。對企業來說,這代表只要 AI API 牽涉個資,內部紀錄、分類與事件應變機制就不能缺。

真正容易出問題的,不是模型,是流程

很多企業不是故意違法,而是在試用階段就把客戶名單、客服紀錄、會議逐字稿或員工資料直接貼進測試 prompt。這類風險往往不是供應商條款能單獨解決的,而是企業是否有做到資料最小化、去識別化、權限控管與內部禁止規則。OpenAI 和 Google 都有濫用監控、短期保留或 logging 機制,因此就算供應商預設不拿資料訓練模型,也不代表可以忽略保留、記錄與權限問題。

第二層風險:營業秘密與機密資訊

在很多公司裡,AI API 最先接到的不是公開資料,而是內部 SOP、產品規格、報價、客戶需求、投標文件、供應鏈資訊與會議紀錄。這時候最直接的法律問題,常常不是個資,而是機密外流與營業秘密。

營業秘密不是只有被偷才算風險

營業秘密的核心通常在於:資訊不是一般人可輕易得知、具有經濟價值,而且權利人有採取合理保密措施。企業如果把原本受保護的資料在沒有明確控管下大量送進外部 AI 工作流,風險不一定會立刻變成訴訟,但很容易先削弱原本的保密管理基礎。這部分即使不引用法條全文,風險判斷也很明確:公司若沒有先畫線,最容易先輸在內控而不是輸在技術。

最容易被忽略的,是部門自行試用

很多法務、業務、行銷、採購、客服部門會先各自用個人帳號或免費工具測試,這時候最常進模型的,反而是最接近商業機密的一手內容。企業真正該防的,不只是外部駭客,而是「內部員工把不該送出的內容送出去」這件事。

第三層風險:著作權與內容來源責任

企業拿 AI API 做內容生成時,另一個常見風險是著作權。

不是只有輸出會侵權,輸入也可能有問題

如果公司把他人受保護的文章、報告、內部教材、競品內容、授權不明文件整包送進模型,再要求摘要、改寫、重組或重製,法律問題不一定出在模型本身,而可能先出在你有沒有權利這樣使用原始內容。這也是很多企業導入 AI 時容易忽略的點:不是只有 AI 生成結果要看,原始素材也要看。

生成內容對外發布後,風險才真正開始

如果 AI API 產生的行銷文案、白皮書、產品頁、簡報、客服知識文被公司正式對外使用,那麼內容是否誤用他人作品、是否過度接近既有表述、是否夾帶未經授權資料,都會變成企業自己的風險,而不是一句「是 AI 寫的」就能切掉。

第四層風險:廣告、消保與對外陳述責任

台灣公司若用 AI API 產生對外客服回覆、商品描述、宣傳文案、比較內容、療效說明或投資相關陳述,最容易碰到的是消保與不實表示風險。

AI 說錯,不代表公司就沒責任

如果 AI 生成的內容被公司直接拿去上架、發信、投放廣告或回覆客戶,那最後外部看到的是公司訊息,不是模型實驗品。企業最常忽略的風險,就是把「草稿工具」直接變成「正式輸出工具」,中間沒有審核層。

對消費者、客戶與合作方,錯誤資訊都可能變責任

商品規格、價格條件、適用範圍、退換貨承諾、效果說明、交期與保固等內容,一旦由 AI 產生又未經審核,最後可能不是單純答錯,而是變成契約爭議、消費者爭議甚至廣告爭議。這類風險的重點不在 AI 技術,而在企業是否把 AI 輸出視為「未審核草稿」而不是「可直接對外的正式表述」。

第五層風險:契約責任與供應商管理

企業只要開始用 AI API,通常就不是只有內部問題,還會進入供應商條款與合約責任。

同一家供應商,不同產品線規則可能不同

OpenAI、Anthropic、Google 都不是「所有產品都同一套資料規則」。例如 Google 的 Gemini Developer API 免費層資料可用於改善產品,但付費層不會;Vertex AI 又是另一條企業雲端路線。這代表企業若沒先分清楚到底在用哪一種方案,風險可能從一開始就走錯。

條款看錯,內部資料政策就可能整個偏掉

真正常見的問題不是供應商隱瞞,而是企業內部根本沒有人完整看過條款、保留、地區、快取、日誌與資安文件。這種情況下,技術上看起來是導入 AI,法律上卻可能是沒有完成供應商審查。

第六層風險:員工直接用,企業卻沒有制度

很多公司沒有正式上線 AI API,風險卻已經發生,因為員工早就在工作中自己用。

沒制度,比有工具更危險

真正的高風險狀態通常不是公司正式買了 API,而是公司根本沒規則,導致每個人自己用不同帳號、不同工具、不同資料、不同 prompt 在工作。這種情況下,企業不只看不到資料流向,也很難稽核誰送過什麼內容出去。

企業最該先做的是內部使用政策

在正式談模型、RAG、工作流之前,企業其實更該先寫清楚:

哪些資料不能進模型哪些場景一定要匿名化哪些輸出不能直接對外哪些部門要先經法務或資安審查哪些方案或帳號類型不能用來碰內部資料

這類規則不一定複雜,但一定要先有。否則責任不是不存在,而是分散到找不到人負責。

台灣公司真正最容易忽略的,不是法條,而是邊界

很多公司對法律風險的理解還停在「AI 會不會違法」。但真正更常出事的,通常不是模型本身,而是這幾個邊界沒有先畫好:

資料邊界:哪些資料能進、哪些不能進

人員邊界:誰能用、誰能批、誰能看到結果

產品邊界:免費層、付費層、企業版、雲端版是不是混用

用途邊界:哪些只能做輔助、哪些不能直接對外

審核邊界:哪些輸出一定要人工覆核

這些事情如果沒先做,法律責任就很容易在真正出事時一次全部浮上來。

結論

台灣公司使用 AI API,當然可能有法律責任。真正的問題從來不是「用了 AI API 會不會自動違法」,而是公司有沒有把 AI 當成一個受管理的企業流程,而不是一個誰都能亂用的外部工具。

在台灣 2026 年的法制與政策方向下,企業若把 AI 接進內部資料與日常作業,最該先看的不是模型排行榜,而是個資、機密、著作權、對外陳述、供應商條款、日誌保留、地區與內控規則。台灣《人工智慧基本法》已經把隱私、資料治理、資安、透明與責任列成治理方向;供應商官方文件也都把訓練、保留、區域與商業資料處理規則寫得比以前更清楚。這代表企業真正要做的,不是逃避使用 AI,而是先把邊界畫清楚,再決定怎麼安全上線。

常見問題

台灣公司用 AI API,本身就違法嗎?

不是。法律風險通常不在「有沒有用」,而在怎麼用、拿什麼資料用、用在哪些流程、是否有適當控管。

最先會碰到的法律問題通常是哪一類?

最常先碰到的是個資、機密與對外內容責任。尤其當企業把內部資料、客戶資料或未審核內容直接送進模型或直接對外使用時,風險會最快浮現。

API 供應商說不拿資料訓練,是不是就安全了?

不等於完全安全。訓練只是其中一塊,還要看保留、日誌、區域、權限、快取與內部流程治理。

企業導入前最該先做的是什麼?

通常不是先選模型,而是先做資料分級、場景盤點、供應商條款審查與內部使用規則。

免費層和付費層差很多嗎?

可能差很多。至少在 Google 的 Gemini Developer API 上,免費層與付費層在資料是否可用於改善產品這件事上就有明確差異。

這篇和一般 AI API 教學文差在哪裡?

這篇不是教你怎麼申請 API,也不是泛談平台差異,而是固定鎖在「台灣公司用了 AI API 之後,法律責任會怎麼出現」這個企業導入前問題。

如果想先把企業內部資料能不能接 AI API 這件事看懂,也可以先回到企業內部資料可以用 AI API 嗎?導入前先看懂風險與邊界,先把資料使用邊界與導入風險釐清。

如果想從更完整的角度理解模型、API、平台與使用方式,也可以先回到AI Token整理頁一次看。

資料來源與可信度聲明

本文以台灣公司導入 AI API 的法律與法遵風險為主,主要參考台灣官方法規與供應商官方文件,包括台灣 2026 年公布的《人工智慧基本法》、台灣《個人資料保護法》、OpenAI 的Business Data Privacy與Enterprise Privacy、Google Cloud 的Vertex AI and zero data retention與Gemini API Pricing。

文章重點不是替個案提供法律意見,而是幫企業先把最常見的責任來源看清楚:資料進模型之前的合法性、資料進模型之後的治理,以及輸出被正式使用後的企業責任。

台灣《人工智慧基本法》已於 2026 年 1 月 14 日公布,並把隱私保護與資料治理、資通安全、安全性、透明與課責列為治理原則;OpenAI 官方則寫明 API 平台與企業產品的資料預設不會用於訓練模型;Google Cloud 也明確表示,在 Vertex AI 上未經客戶事前許可或指示,不會用客戶資料訓練或微調 AI/ML 模型。

本篇文章屬於《企業 AI 導入與資料安全》分類

這個分類聚焦在企業把 AI 接進內部流程之前,最容易忽略的資料安全、治理、權限、邊界與導入風險。適合已經不再只是想知道 AI 好不好用,而是開始思考資料能不能接、怎麼接、接了之後怎麼控管的讀者。

留言