用 Claude API 前要先確認什麼?成本、模型、權限重點整理

- 10分钟前

- 讀畢需時 10 分鐘

用 Claude API 前,最容易做錯的不是程式不會寫,而是太快開始接。帳號開了、API key 建了、文件打開了,就直接開始測;結果用了幾天後才發現模型選錯、ai token 成本抓錯、權限不夠、速率限制卡住,甚至連哪些功能會另外計費都沒先搞清楚。

Anthropic 官方文件其實把很多關鍵資訊寫得很清楚,包含模型差異、定價、rate limits、prompt caching、batch processing、web search 等,只是新手最常見的問題是:資訊都在,卻不知道開始前到底要先看哪幾項。

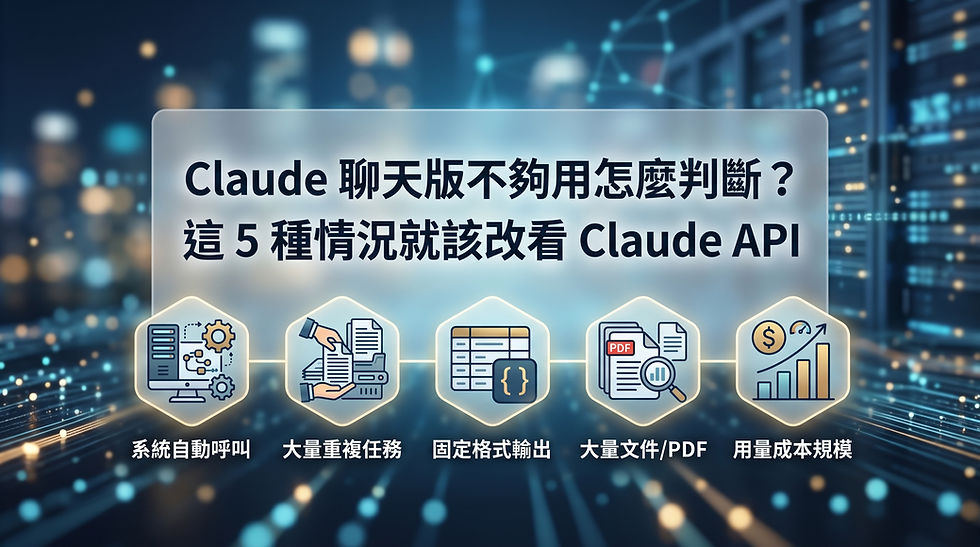

這篇文章不走「Claude API 是什麼」那條線,也不重複「哪些人適合用 Claude API」那篇的內容,而是直接整理成正式開始前的檢查清單。重點放在三件事:成本怎麼抓、模型怎麼選、權限和限制怎麼確認。這樣的角度和你站上既有的「Claude API 是什麼?和 Claude 聊天版差在哪」以及「Claude 聊天版不夠用怎麼判斷」可以分開,不會直接互打。

先講結論:開始用 Claude API 前,至少先確認 3 件事

開始前最少要先確認三件事。

第一,成本預估方式對不對。不是只看單價,而是要知道 input、output、cache、batch、額外工具費用怎麼算。Anthropic 官方定價頁明確把 model pricing、prompt caching、long context pricing、batch discount 與 web search 的額外費用分開列出。

第二,你選的模型是不是符合任務。Anthropic 官方 models overview 會把不同 Claude 模型的用途分開,從高階複雜任務到更快、更省成本的模型,定位很明確。

第三,帳號與權限是否已經能支撐正式使用。Rate limits 文件明確指出,Claude API 會受 spend limits 與 rate limits 共同約束,而且 rate limits 會依 usage tier 而不同。

只要這三塊沒先確認清楚,後面不管你是個人、小團隊還是企業,都很容易在正式上線後才開始補洞。

先不要急著串,先確認你要拿 Claude API 解什麼任務

這一步很多人會跳過,但其實最重要。Claude API 不是單純把聊天版搬到程式裡,它更像是把 Claude 的能力接進你自己的流程。Anthropic 官方除了基本的 Messages API,也提供 token counting、message batches、prompt caching、tool use、vision、web search 等能力。也就是說,你先要知道自己要做的是哪一類任務,才知道後面該怎麼選模型、抓成本和設計權限。

標準文字任務,重點會落在模型與成本

像是:

內容生成

摘要

分類

改寫

FAQ 整理

一般文字工作流

這類任務通常最該先看的,就是模型選擇與 ai token 成本結構。

Agent、搜尋、工具型任務,重點會落在功能與限制

像是:

tool use

web search

文件工作流

外部資料整合

多步驟 agent 流程

這類任務不只要看 token 單價,還要看功能可用性、額外費用、權限治理與 rate limits。Anthropic 官方 web search 文件就明確寫到,web search 是按每 1,000 searches 收費,並且搜尋結果內容還會計入 token usage。

批次型任務,重點會落在 Batch 與 throughput

像是:

大量分類

批量摘要

離線內容整理

評測

夜間處理任務

這類場景如果不先看 batch pricing,很容易高估成本。Anthropic 官方定價頁直接寫出 batch processing 可省 50% 。

所以第一個確認點其實很簡單:你不是要「用 Claude API」,你是要「拿 Claude API 解哪一種任務」。

成本先看什麼:不要只看每百萬 token 單價

新手最常犯的第一個錯,就是只看 Claude API 單價表,然後以為價格很直觀。實際上,Anthropic 官方定價至少要分成幾塊來看:

input token

output token

prompt caching

batch processing

某些功能的額外費用

Anthropic 官方 pricing 頁目前把 Claude 模型分成 Base Input Tokens、5m Cache Writes、1h Cache Writes、Cache Hits & Refreshes、Output Tokens 等欄位。

成本不是只問「一百萬 token 多少錢」

真正該先問的是四件事:

你的 input 有多長

你送進去的 system prompt、知識背景、歷史對話、工具定義、文件內容,都會影響 input token。

模型會回多長

很多模型的 output 單價本來就比 input 高,Claude 也不例外。Anthropic 官方定價頁清楚列出 output tokens 單價高於 base input tokens。

你是不是一直重送重複內容

Prompt caching 的存在,本身就在告訴你:重複背景如果沒有利用快取,成本常常會被高估。Anthropic 官方說 prompt caching 可以透過 cache write / cache read 降低重複處理成本。

你有沒有用到額外功能

像 web search 這種功能不是只有 token 費,還有額外功能費。Anthropic 官方 web search 文件明確寫出是 $10 per 1,000 searches plus standard token costs。

Prompt caching 先怎麼看:不是有開就一定划算

Prompt caching 不是只是「打開就會省」,而是要看你的流程有沒有大量重複前綴。Anthropic 官方文件寫得很清楚:

5 分鐘 cache write:1.25x base input

1 小時 cache write:2x base input

cache read:0.1x base input

哪些情況特別值得先看 caching

像是:

很長的 system prompt

固定規則

固定品牌語氣

重複知識背景

多輪對話

重複文件前綴

只要你的 Claude API 工作流本來就會反覆帶相同背景,prompt caching 就非常值得先評估。但如果你的請求每次都差很多、幾乎沒有重複前綴,那 caching 就不一定是最優先的省成本手段。

Batch processing 先怎麼看:非即時任務要特別留意

Anthropic 官方 pricing 頁和 batch processing 文件都很清楚:batch processing 可節省 50% 成本。

什麼任務最適合先考慮 batch

像是:

批量摘要

批量分類

批量標註

大量改寫

夜間資料處理

評測任務

這類任務不是即時客服,也不是要立刻回覆終端使用者,所以本來就更適合走 batch。對這類場景來說,先想清楚能不能 batch,通常比一直糾結模型單價更重要。

模型先怎麼選:不是越強越好,而是要對任務

Anthropic 官方 models overview 把 Claude 模型定位分得很清楚。實務上最重要的不是把模型名字背起來,而是知道:你的常見任務適合哪一種層級。

高階複雜任務,先看更高能力模型

像是:

複雜推理

長流程 agent

程式工作流

高可靠性輸出

多步驟規劃

這類任務先看高階模型比較合理。因為你在意的不只是單價,而是正確率與穩定度。

一般商業應用與主力工作流,先看平衡型模型

像是:

一般產品整合

內容生成

中高頻工作流

知識整理

常規問答

這種場景更適合先看速度與能力平衡的主力模型,而不是一開始就選最強或最便宜。

高頻低成本任務,先看成本效率型模型

像是:

大量分類

快速摘要

標準問答

輕量客服

前處理任務

這類任務真正該看的是:夠不夠快、夠不夠便宜、品質是不是已經夠用。

模型還要看兩個最常被忽略的限制:context window 和 max output

很多人知道模型有快慢和價格差,但忽略了 context window 和 max output 才是實務上最常踩坑的地方。

Anthropic 官方 pricing 頁對 long context pricing 說得很清楚:1M token context window 目前只適用於 Claude Sonnet 4,而且超過 200K input tokens 會進入更高的 long context pricing。

為什麼 context window 不能忽略

因為你要處理的可能不是單純短 prompt,而是:

很長文件

很多背景資料

大量檢索片段

長對話歷史

複雜系統規則

這時候如果 context window 不夠,問題不是成本而已,而是任務根本跑不順。

為什麼 max output 也要先看

有些任務需要模型回長報告、長程式碼、長 JSON、長整理結果。這時候你不能只看「模型夠不夠聰明」,還要看「它一次能回多長」。不然很容易在正式使用時才發現輸出空間不夠。

權限先確認什麼:不是只有 API key 而已

很多人以為權限就是「有 API key 就能用」,但這理解太淺。Claude API 真正在開始前要確認的權限,至少包含:

API key

workspace

帳務/spend limits

rate limits

你要走哪一種平台路徑

Anthropic 官方文件指出,Claude 模型可以透過 Claude API、AWS Bedrock、Google Vertex AI 使用。這不只是技術差異,也會影響帳務、權限治理、採購與整合方式。

原廠 Claude API 還是雲平台路徑,要先決定

這一點很多人會拖到最後才想,但其實應該一開始就確認。因為你選的是:

Anthropic 原廠 API

AWS Bedrock

Google Vertex AI

後面在帳務、權限、整合、企業治理上就會不一樣。

Workspace、付款與 usage tier 也不能跳過

Anthropic 的 rate limits 文件明確指出:

有 spend limits

有 rate limits

limits 依 usage tier 而不同

rate limits 會分 requests per minute、input tokens per minute、output tokens per minute

這件事很重要,因為很多人本地測試都正常,一上線才發現頻率一高就被限流。

Rate limits 先看什麼:不是 call 成功就代表能正式上線

你如果一開始就知道自己會有高併發、大批量任務、或大量工具呼叫,就不能只確認「能不能 call 成功」,而是要先確認「正式流量下撐不撐得住」。

Anthropic 官方文件把 rate limits 拆得很清楚:

RPM:requests per minute

ITPM:input tokens per minute

OTPM:output tokens per minute

這些限制為什麼和 AI Token 有關

因為 ai token 不只影響帳單,也直接影響吞吐量。尤其是 ITPM 和 OTPM,本質上就是你每分鐘能送多少、能回多少 token。所以開始用 Claude API 前,不只是要看單價,還要看你的用量結構會不會很快撞到限制。

功能權限也要先看:不是每個能力都跟基本訊息一樣

Claude API 現在不只是 Messages。你如果要用:

web search

prompt caching

message batches

tool use

其他進階能力

最好一開始就先確認這些功能的適用條件與額外成本。

Web search 不是只有 token 費

Anthropic 官方 web search 文件明確寫到:

Web search usage is charged in addition to token usage

價格是 $10 per 1,000 searches

搜尋結果內容還會計入 input tokens

這代表 web search 不是只是多一個功能,而是多了一條費用結構。

Prompt caching 不是所有場景都同樣值得開

官方文件說得很清楚,cache write、refresh、read 有不同價格,而且只有在你有重複前綴內容時,這個功能才真正划算。

所以開始前不能只問「Claude 能不能做」,還要問:

這個功能的成本我能不能接受

這個功能對我的流程有沒有真正價值

這個功能會不會影響限制與治理

開始前最值得先做的一件事:先跑一次小規模成本試算

如果真的不想一開始就踩雷,最務實的方法不是一直看文章,而是先做小規模成本試算。Anthropic 官方提供 Token Counting,目的就是讓你在真正送請求前,先估大概會用多少 tokens。

先拿真實任務測一次,比看表更準

你可以先拿真實會用的資料測一次,例如:

你實際會送多長的 system prompt

你會附多少上下文

你預期模型回多長

你是不是會一整天重複送同一類內容

你要不要做 batch

你會不會用 web search

把這些加起來,對成本的掌握會比只看定價表準很多。這也是為什麼官方除了 pricing 頁,還提供 token counting、batch、caching 這些配套能力。

新手最常漏掉的 5 個確認點

第一個:把聊天版體驗誤當 API 成本

聊天時你覺得一段內容不長,但 API 是照 ai token 算,而且 system prompt、上下文、工具結果都可能一起算進去。

第二個:一開始就選最強模型

高階模型很強,但如果任務其實是標準摘要、分類、短回覆,通常不一定最適合。

第三個:沒先看 rate limits

小量測試不會出問題,不代表正式上線不會卡。官方明確有不同 usage tier 的不同限制。

第四個:看了 prompt caching,但流程根本沒有重複前綴

這樣不一定省,甚至只是多了一層複雜度。

第五個:忘了某些功能會另外計費

web search 就是最典型例子,不是只有 token 費而已。

最後總結

在你開始用 Claude API 前,真的要先確認的,不是只有「我拿到 key 了沒」,而是三大塊。

第一塊是成本。你要先看 input、output、cache、batch、額外工具費用,不能只看表面單價。第二塊是模型。你要先根據任務去分辨高能力、平衡型、成本效率型模型的差異,尤其是智慧、速度、context window、max output 和價格。第三塊是權限。你要先確認 API key、workspace、付款、usage tier、rate limits,以及你到底走原廠 API、Bedrock 還是 Vertex AI。

真正比較穩的做法,不是開了就接,而是先拿真實任務跑一次小規模試算,再決定模型和功能組合。這樣後面不管你是個人、小團隊還是企業,踩坑機率都會低很多。

FAQ

用 Claude API 前,最先要看的是價格還是模型?

兩個都要看,但順序通常是先確認任務,再選模型,再抓成本。因為模型不同,價格、context window、適用情境都不同。

Claude API 的成本是不是只看 input token 和 output token?

不是。Anthropic 官方還有 prompt caching、message batches、web search 等不同費用結構。尤其 web search 是另外按搜尋次數計費。

有 API key 就代表可以正式上線嗎?

不一定。你還要確認 workspace、付款狀態、usage tier、rate limits,以及正式流量下是否會被限流。Anthropic 官方文件有明確說明 rate limits 會依 tier 不同而變化。

我只是先測試,也要看 prompt caching 和 batch processing 嗎?

少量測試可以先不用看太深;但如果你預期會大量重複送相同前綴內容,或要做大量非即時任務,prompt caching 與 batch processing 很值得先評估。

AI Token 和 Claude API 的關係是什麼?

AI Token 是 Claude API 的基礎計量單位之一,會直接影響 input、output、rate limits 與總成本,所以開始前一定要一起看。

資料來源與可信度聲明

本文主要依據 Anthropic 官方定價頁、Claude API 官方文件、Models Overview、Rate Limits 文件,以及 Token Counting、Prompt Caching、Batch Processing、Web Search Tool 等功能文件整理,優先採用第一手來源說明成本、模型、限制與功能差異。

重點參考以下官方來源:

本文以「官方模型定位 × 官方價格結構 × 正式上線前檢查清單」三層方式整理,文中對開始前該先確認什麼的排序,屬於根據官方資料與實務使用情境所做的整理,不等同於官方唯一建議流程。

想先看懂 AI 平台、工具與採購的主戰頁,可以先從這篇開始

本篇文章屬於《AI 平台、工具與採購》分類。

此分類主要整理 AI 平台、API、工具選型、採購方式、原廠與第三方差異、權限治理與正式導入前的判斷重點,幫助新手、小團隊與企業在接觸 AI API 時,不只會接,也知道該怎麼選、怎麼買、怎麼控風險。

留言