法律合約可以上傳到 AI API 嗎?法務最常擔心的 7 個問題

- 4月29日

- 讀畢需時 8 分鐘

法律合約可以上傳到 AI API,但不適合不分級就直接把整份原文丟進去,而且確實有風險。

最常見的風險不在「模型能不能讀」,而在合約裡是否包含個人資料、商業機密、附件資訊、未公開交易條件,以及你用的是哪一種產品方案、資料會不會被保留、輸出有沒有經過人審。對法務來說,法律合約不是不能交給 AI 處理,而是必須先把資料邊界、使用條件與內部 SOP 畫清楚,再決定哪些內容能進模型、哪些只能在受控環境下處理。

OpenAI 明確表示 API 平台與企業產品的資料預設不會用於訓練模型;Anthropic 也表示商業產品的輸入與輸出預設不會用於訓練;Google Cloud Vertex AI 也寫明未經客戶事前許可或指示,不會用客戶資料訓練或微調模型。

真正該先回答的,不是「可不可以丟」,而是三件事:這份合約裡有沒有敏感資料、這條產品路線的資料規則是什麼、公司內部有沒有定義好誰可以上傳與誰可以看結果。台灣《個人資料保護法》對可識別自然人的資訊有明確規範;台灣 2026 年公布的《人工智慧基本法》也把隱私保護與資料治理、資通安全、透明與課責列為治理原則。這表示法律合約進 AI API 不是無法可管,而是更需要企業自己先把資料治理做完整

如果想先把企業內部資料能不能接 AI API 這件事看懂,也可以先回到企業內部資料可以用 AI API 嗎?導入前先看懂風險與邊界,先把資料使用邊界與導入風險釐清。

這篇在處理什麼問題

這篇處理的不是一般 AI Token 計算,也不是單純的平台比較,而是更具體的法務導入問題:法律合約可不可以上傳到 AI API、法務最常擔心的風險是什麼、哪些風險可以透過產品選型降低、哪些風險一定要靠企業內部流程解決。

法律合約不是一般文件

法律合約通常同時包含交易條件、責任分配、價格條款、聯絡人資訊、附錄、談判結果與保密內容。這些內容一旦進入模型,不只是 AI Token 消耗增加,更會連動到個資、機密、權限、保留與輸出責任問題。

AI Token 重要,但不是第一順位風險

法律合約進模型後,AI Token 當然會增加,尤其是長文件、多輪追問、附件多的場景。但對法務來說,真正應該排在前面的通常是資料合法性、保密義務與內部治理。也就是說,在法律合約場景裡,AI Token 是成本問題,但資料風險才是治理問題。

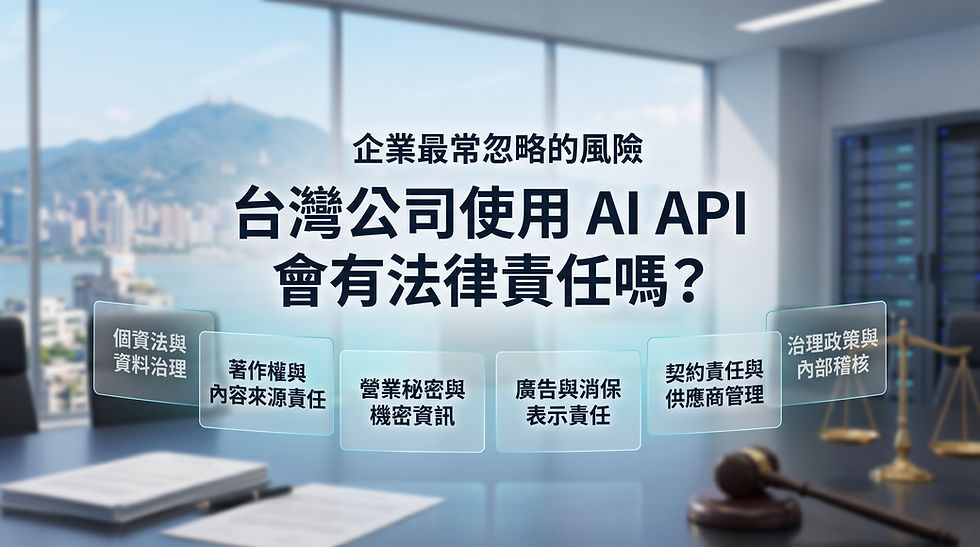

法務最常擔心的 7 個問題

第一個問題:這份合約裡有沒有個人資料

法律合約最容易被忽略的,不是正文,而是附件與簽署頁。聯絡窗口姓名、電話、電子郵件、職稱、身分資訊、銀行資料、地址,甚至某些勞務、醫療、教育或金融文件裡的敏感資料,都可能直接出現在合約或附件裡。台灣《個人資料保護法》管的不是文件名稱,而是裡面是否有可識別自然人的資訊。只要合約裡有這類內容,就不能把它當成一般無風險文件處理。

最容易出問題的,不是主契約而是附件

很多人會先看主文條款,但忽略了附錄、簽署頁、對保文件、付款資訊、通訊錄與背景文件。這類內容一旦被整份送進 AI API,問題就不只是摘要或檢索,而是已經進入個資處理場景。

第二個問題:這份合約裡有沒有機密資訊或營業秘密

就算合約裡沒有個資,也幾乎一定可能有機密。價格、授權方式、責任上限、違約條件、談判結果、技術條款、商業安排與合作模式,都是企業通常不希望外流的內容。這類資料的風險點不只是「會不會被拿去訓練」,而是公司有沒有維持合理保密措施。

臨時試用往往比正式導入更危險

很多風險不是出在正式企業版,而是出在測試階段。法務、業務或商務同事為了快,先把合約貼進免費工具、個人帳號或未審核的第三方服務。這種情況下,問題往往不是模型本身,而是企業根本沒有管住資料入口。

第三個問題:供應商會不會拿合約內容訓練模型

這是法務最常先問的一題,而且一定要先確認。

商業產品與免費產品不能混為一談

OpenAI 官方寫明,API 平台與企業產品的資料預設不會拿來訓練模型。Anthropic 也表示商業產品的資料預設不會用於訓練。Google 這邊則不能一概而論,Gemini Developer API 免費層資料可用於改善產品,付費層則不會,而 Vertex AI 又是另一條企業級路線。這代表企業不能只記「Google 可以」或「Google 不行」,而要看你實際走的是哪個方案

不訓練,不代表完全沒有保留或監控

即使供應商不拿資料訓練模型,也不代表完全沒有日誌、濫用監控、快取或短期保留。企業若真的要把法律合約送進 AI API,就不能只看「不訓練」三個字,而要繼續往下問:會不會保留、誰能看到、可不可以要求更嚴格設定。

第四個問題:這份合約能不能原文直接上傳

很多情況下,真正合理的做法不是原文整份直送,而是先做資料最小化。

不是每一次審查都需要完整原文

如果法務只是在檢查付款條款、終止條件、責任限制或競業禁止,不一定需要整份原文都進模型。比較穩妥的做法通常是只送與任務直接相關的條文,或先移除簽署頁、聯絡資訊、無關附件與敏感識別資訊。

最小化不只是安全,也能降低 AI Token 成本

法律合約通常頁數長、文字密度高。若先裁切掉與本次任務無關的部分,不只資料風險會降低,AI Token 消耗也會跟著下降。這讓資料治理與成本治理在這個場景裡其實是同方向的。

第五個問題:用了企業版或 API,就一定安全嗎

不一定。產品方案很重要,但不能把企業版當成萬能保證。

企業版解決的是供應商端規則,不是你的內部流程

OpenAI、Anthropic、Google 的商業產品條款,主要能處理的是供應商是否訓練資料、資料如何被處理、是否提供企業級治理選項。但企業自己怎麼分資料、誰有權限、哪些內容能上傳、輸出能不能對外用,這些還是公司的責任。

真正常見的問題是權限與流程

法律合約進模型之後,最容易出問題的不是模型突然把資料拿去訓練,而是公司內部誰都能上傳、誰都能看到結果、誰都能轉發輸出,導致原本應該受限的文件流向變得無法稽核。

第六個問題:AI 審完的結果能不能直接當正式法律意見

通常不應直接這樣用。

AI 比較適合做摘要、比對、標註與白話整理

法律合約 AI 最適合的角色,通常是摘要、條款標註、重點比對、白話說明與初步風險提示,而不是直接代替法務或律師做最終結論。尤其是責任限制、賠償範圍、排他條款、競業禁止、跨境義務、爭議處理這類高風險條文,更不適合跳過人審。

一旦正式採用,責任通常還是回到企業

如果公司把 AI 審查後的內容直接拿去修改契約、回覆對方、形成正式意見或對外溝通,最後出問題時,責任通常還是公司自己承擔,而不是一句「這是 AI 寫的」就能切掉。

第七個問題:內部到底要建立什麼標準作業

法律合約能不能進 AI API,最後通常不是模型決定,而是 SOP 決定。

第一,先做資料分級

至少要先分清楚:哪些合約可直接進模型、哪些一定要去識別、哪些只能進企業版或特定受控環境、哪些根本不能進外部模型。沒有這一層,後面所有判斷都會變成個人經驗。

第二,先做用途分級

摘要、翻譯、條款比對、修改建議、風險標註,風險程度不同。企業不應把所有用途視為同一件事。這不只更安全,也更容易管理 AI Token 配額與模型權限。

第三,保留人工覆核邊界

最少要先定出:哪些輸出只能做內部參考、哪些輸出一定要法務複核、哪些內容不得直接對外採用。這條線沒有先畫清楚,AI 導入就很容易從效率工具變成風險來源。

結論

法律合約可以上傳到 AI API,但前提不是「直接丟上去」,而是先做分級、最小化、方案判斷與內部授權。比較實用的答案是:低敏感、已處理、用途明確的合約內容,可以在合適的商業產品與企業 API 環境下使用;高敏感、含個資、含附件、含談判細節與未公開交易條件的內容,則不適合不經處理就直接送進模型。

供應商條款已經比過去清楚很多,但它們解決的只是供應商那一層。真正決定風險高低的,仍然是企業自己有沒有把資料最小化、去識別化、權限控管、產品選型、AI Token 管理與輸出審核做完整。法律合約不是不能用 AI API,而是不能沒有規則就用。

常見問題

法律合約可以直接丟給 AI API 嗎?

可以,但不建議不分級就直接整份原文送進去。應先確認是否含個資、機密、附件與受限條款,再決定是否需要匿名化、裁切或改用企業級方案。

OpenAI、Claude、Google 會拿合約內容訓練模型嗎?

商業產品與企業 API 的官方說法通常是不會預設拿來訓練,但不同產品線與方案仍有差異,像 Gemini Developer API 免費層與付費層就不同,因此一定要看實際用的是哪一條產品路線。

法務最該先擔心的是 AI Token 成本嗎?

不是。AI Token 很重要,但法律合約場景下,個資、機密、保密義務、輸出採用與權限控管通常比成本更優先。只是當工作流穩定後,AI Token 使用量與配額管理才會變成第二層治理問題。

去識別化之後就一定安全嗎?

不一定。去識別化能降低風險,但還要看資料是否仍可被間接識別、是否還有附件沒處理,以及企業本身的權限與保留規則有沒有跟上。

AI 審查合約的結果可以直接當正式法律意見嗎?

通常不建議。AI 更適合做摘要、比對、提示與白話整理,最終法律判斷仍應保留人審邊界。

這篇和一般 AI API 教學文差在哪裡?

這篇不是教怎麼申請 API,也不是泛談平台差異,而是固定鎖在「法律合約可不可以進 AI API」這個法務導入前問題,重點放在資料、邊界、風險與內部 SOP。

資料來源與可信度聲明

本文以法律合約上傳到 AI API 的法務與資料治理情境為主,主要參考台灣官方法規與主流供應商官方資料,包括台灣《個人資料保護法》、台灣《人工智慧基本法》、OpenAI Business Data Privacy、Anthropic 商業資料處理與訓練說明、Gemini API Pricing與Google Cloud Vertex AI Data Governance。文章重點不是提供個案法律意見,而是幫法務與企業先把法律合約進 AI API 前最常見的風險來源、條件與內部邊界看清楚。

本篇文章屬於《企業 AI 導入與資料安全》分類

這個分類聚焦在企業把 AI 接進內部流程之前,最容易忽略的資料安全、治理、權限、邊界與導入風險。適合已經不再只是想知道 AI 好不好用,而是開始思考資料能不能接、怎麼接、接了之後怎麼控管的讀者。

如果想先把企業內部資料能不能接 AI API 這件事看懂,也可以先回到企業內部資料可以用 AI API 嗎?導入前先看懂風險與邊界,先把資料使用邊界與導入風險釐清。

留言